728x90

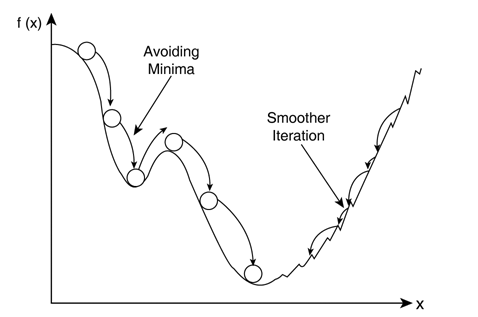

안녕하세요, 오늘은 경사하강법 (Gradient Descent Method)의 문제점인 local minimum, plateau (평탄한 지점)에 빠지거나 수렴속도가 느리다는 단점을 해결하고자 나온 모멘텀 (Momentum)에 대해서 배워보도록 하겠습니다.

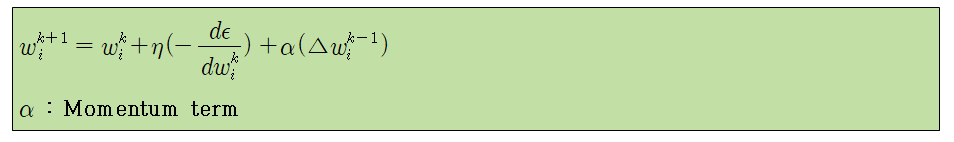

모멘텀은 경사하강법 (Gradient Descent Method) 통해 W가 이동하는 과정에서 일종의 '관성'을 부여하는 것입니다. 즉 W를 업데이트 할 때에 이전 단계의 업데이트 방향을 반영하는 것입니다.

따라서 위 그림처럼 Local Minimum 을 피할 수 있게 해주며, 이전 속도가 더 반영되므로 수렴속도도 빨라지게 됩니다.

하지만 Momentum에도 단점이 있는데, W를 업데이트 할 때마다, 과거에 이동했던 양을 변수별로 저장해야하므로 변수에 대한 메모리가 2배로 소모된다는 것입니다.

다음으로 모멘텀 방식을 기초로 하지만, 모멘텀을 약간 변형한 Nesterov 모멘텀 에 대해서 배워보도록 하겠습니다.

Nesterov 모멘텀은 모멘텀에 의해 연두색 화살표의 끝점으로 이동한 후, 그 위치에서 그라디언트를 계산하여 W를 갱신하는 방법입니다.

실제로 그냥 모멘텀보다 Nesterov 모멘텀이 더 widely 하게 사용되고 있다고 합니다.

'데이터 다루기 > 신경망' 카테고리의 다른 글

| [신경망] 6. 활성화 함수 (Activation Function) (0) | 2019.06.03 |

|---|---|

| [신경망] 5. 역전파 알고리즘 (Backpropogation) (0) | 2019.06.01 |

| [신경망] 3. 경사하강법 (Gradient Descent) (2) BGD, SGD (0) | 2019.06.01 |

| [신경망] 2. 경사하강법 (Gradient Descent) (1) Adaline (0) | 2019.06.01 |

| [신경망] 1. 퍼셉트론 (0) | 2019.06.01 |