안녕하세요, 이번 포스팅에서는 선형회귀분석의 발전 단계인 능형 회귀 모형에 대해서 배워보도록 하겠습니다.

능형 회귀 분석은 축소 방법 (Shrinkage method) 중 하나로, 모형에 분산을 줄여주는 효과를 가져옵니다.

일반적으로 많은 수의 변수를 가지고 선형회귀분석을 하면, Train R-squared는 좋아지지만, 이는 overfitting을 발생시킵니다.

즉, 실제로 새로운 값에 대하여 값을 예측할 때, 성능이 점점 안좋아지게 됩니다.

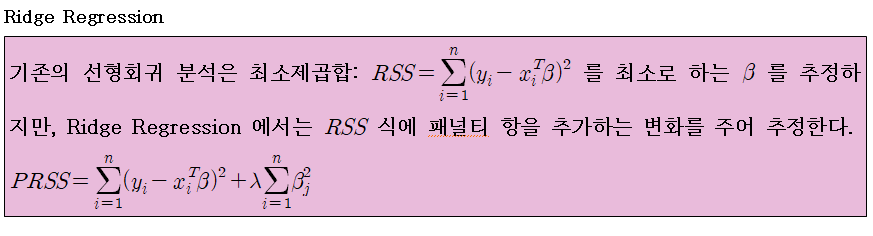

따라서 능형 회귀 모형은 일반적인 선형 회귀 분석의 ß를 추정하는 과정에서, 패널티 항을 추가합니다.

이 때, λ 의 값은 hyperparameter로 분석자가 정해줘야 하는 값입니다. λ 를 너무 크게 정해주면 ßj 들이 전부 0과 가까운 값으로 수렴하게 되고, 작게 정해주면 Ridge를 하는 이유가 사라지게 됩니다.

따라서, 우리 데이터에 가장 적합한 λ 를 발견하는 것이 매우 중요한 문제라고 할 수 있습니다. 주로 Cross-validation 방법을 사용하여 λ 를 추정합니다. 다향한 λ 의 값에 대하여 Cross-validation error 를 측정하고, 이를 가장 작게 만드는 λ 를 최적의 parameter로 선택합니다.

Ridge Regression의 단점으로는, 패널티 항으로, ßj2 을 사용하기 때문에, ßj2 가 0으로 가까워지면 ßj 는 0으로 수렴하는 데, 이 때 0의 값을 가지지는 못합니다. 따라서, 실제로 ßj 가 0에 가까워지긴 하지만, 회귀 모형에서 없어지지는 않습니다.

따라서 Ridge Regression은 변수 선택 방법으로는 사용되지 못합니다.

이러한 Ridge Regression의 한계를 극복하기 위해서 나온 방법이 다음 포스팅에서 배울 Lasso Regression 입니다.

'데이터 다루기 > 머신러닝 이론' 카테고리의 다른 글

| [머신러닝] Logistic Regression (0) | 2019.06.13 |

|---|---|

| [머신러닝] Lasso Regression (0) | 2019.06.12 |

| [머신러닝] 선형 회귀 분석 (2) (0) | 2019.06.12 |

| [머신러닝] 선형 회귀 분석 (1) (0) | 2019.06.11 |

| 모델 평가 (1) | 2019.06.11 |